前言:具身智能的崛起与挑战

具身智能 (Embodied Intelligence) 是人工智能从数字世界迈向物理世界的关键桥梁。智能体通过身体与环境的交互来学习和进化,从而实现真正的自主决策与适应性行为。然而,实现这一愿景并非易事,具身智能的实现面临着数据、算法、执行等多方面的挑战。

phpxWYjlh

AI眼中未来的人形机器人

本文剖析了具身智能的实现路径与技术需求。结合达宽科技在机器人力控领域的深耕,我们希望能为具身智能提供更落地的解决方案,助力具身智能突破“关键一公里”的物理交互瓶颈。

PART 1:具身智能的实现路径

1. 数据:具身智能的基石

真实数据:通过动作捕捉(如外骨骼、VR设备)采集人类或机器人的交互数据(如DexCap、Mobile ALOHA)。通过已部署机器人或真实工业场景中的工业机器人采集交互数据。

合成数据:利用仿真平台(OmniGibson、Habitat)生成虚拟环境中的训练数据,结合可微分渲染(NeRF、Gaussian Splatting)提升真实性。

多模态数据:融合视觉(Ego4D)、语言(VLA模型)、动作(Bridge Data)、力觉(六维力传感器)等信息,构建更周密的环境理解。

挑战:数据多样性、规模、隐私问题,大量工业场景的数据尤为缺乏。

2. 模型:从感知到决策

VLA(视觉-语言-动作)模型:如OpenVLA、PaLM-E,实现多模态对齐与任务推理。

世界模型:通过神经模拟器预测环境动态(如Sora的时空建模),支持长期规划和决策。

泛化技巧:采用仿真到真实(Sim2Real)迁移、数据增强、表征学习等方法提升模型适应性。

力控模型:结合阻抗控制、自适应调节,确保物理交互的柔顺与准确。

挑战:如何让模型在真实世界中稳定执行?

3. 部署与交互:物理交互的“关键一公里”

灵巧操控:机器人需具备类人的精细操作能力(如抓取、打磨、装配)。

实时反馈:低延迟力控(1ms\4ms级响应)确保动态环境中的稳定性。

Sim2Real迁移:将在仿真中训练的策略无缝部署到真实机器人。

挑战:如何解决不确定性接触、外界干扰等问题

PART 2:达宽力控系统如何赋能具身智能?

1. 数据层面:提供真实的力觉反馈

大量真实场景:达宽力控系统已经批量化在工业场景中交付使用,涉及汽车、3C、一般工业中的装配、插拔、打磨、检测等。在达宽科技交付的数十种应用场景的生产过程中,机器人持续积累毫秒级的多维度数据(机器人位置、速度、加速度、传感器采集力、接触力、补偿量等),为行业和客户提供了工艺优化、数据孪生、扩增、训练的数据基础。

增加力觉数据:达宽力控系统提供带标注的力觉数据集,实时采集真实的外部接触力数据,可识别滑动、碰撞、稳定抓取等状态,动态摩擦系数估计等等,助力生成高保真虚拟训练环境,并弥补纯视觉感知的不足。

数据闭环:力控系统记录人类抓取动作、环境交互数据,反哺AI模型优化,加速Sim2Real迁移,如提供力/位/视觉同步数据,提高模仿学习和强化学习中的高保真训练环境,缩小Sim2Real差距。

多种场景工艺数据

2. 模型层面:增强物理交互的可靠性

模型集成:力控模型可动态调整机器人的刚性/柔性,避免过载或操作失败,可与VLA等大模型深度集成,实现语言-视觉-力觉等多模态对齐。

模型泛化:触觉模型可通过物理规律建模,轻量化适配网络(LoRA结构)等技术,从特定场景进行跨场景框架迁移。

3. 执行层面:突破物理交互的瓶颈

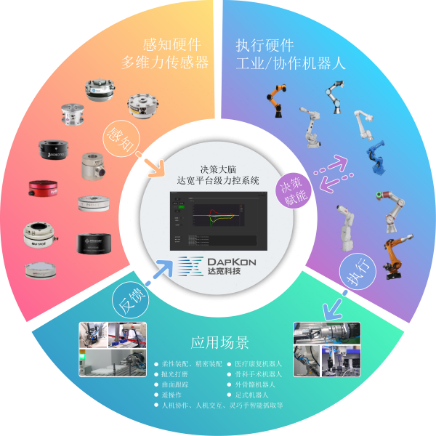

全方面适配:达宽力控系统作为平台级的力控大脑,适配行业主流的传感器和机器人本体(工业、协作、人形、双臂等多种构型),将具身智能从位置序列Tokens生成的运动学层面升级到力位混合序列Tokens生成的动力学层面,为机器人的场景落地提供快捷工具。

多样工艺:达宽力控系统融合了高精度力觉控制、灵巧操作与智能任务规划技术,为装配、检测、打磨等多样化工艺场景提供标准化接口,实现了"千钧之力"与"绣花功夫"的统一。

实时反馈:力控模型可结合空间计算(AR/VR)和低延迟控制(如Holo-Dex)实现动态交互,确保机器人在动态物理环境中的快速响应。

准确复现:通过高精度力控系统,解决具身智能模型"大脑"与执行层面"肢体"的协同难题,真正可靠的执行与物理环境的交互,实现准确的接触力控制与复现。

达宽平台级力控系统

PART 3:具身智能的下一站

AI+力控深度融合:结合VLA模型的语义理解,让机器人“听懂”指令并自主调节执行力度(如“轻拿轻放”、“用力按压”等)。

通用性:从单一力控任务向多任务、多场景、多实体协作(如“机器人团队”)扩展。

更广泛的应用场景:从工业向医疗、农业、家庭服务扩展,需更低成本、更高鲁棒性的力控方案。

开放生态建设:构建力控智能体,与仿真平台、大模型厂商合作,共建“具身智能力控操作系统”。

达宽力控系统

结语:让具身智能真正“落地”

具身智能的实现需以数据为基石、模型为中枢、执行交互为出口,通过多模态学习、仿真与现实融合、以及持续优化,逐步逼近AGI。具身智能的目标是让AI像人类一样与物理世界互动。

从牛顿定律(F=ma)到现代机器人控制理论,对力的准确控制始终是实现物理交互的关键。达宽科技深耕力控技术领域,通过实时力觉反馈、准确力编程和动态力分析,在模型算法与物理执行之间架起智能桥梁,这正是解决具身智能'关键一公里'落地难题的重点所在。'编程力,编织世界'——达宽科技正在赋能AI与物理世界的深度融合。

我们相信,当AI的“大脑”与力控的“肢体”协同,具身智能将不再局限于实验室,而是真正走进工厂、医院、家庭,改变我们的生活。

还没有评论,赶快抢占沙发~!