一、能效管理从政策要求走向运营刚需

在"东数西算"工程持续推进的背景下,数据中心的能耗管理已从合规导向转变为成本优化的关键议题。工信部与国家发改委联合发布的行业指导文件明确提出,新建大型数据中心PUE值应控制在1.3以下,既有设施需通过技术改造逐步达标。对于承担关键业务的运维团队而言,如何在不中断服务的前提下实现能效跃升,成为当前阶段的现实挑战。

传统风冷架构在高密度算力场景下暴露出散热瓶颈:当单机柜功率密度超过8kW时,空调系统能耗占比可达总能耗的40%以上,且存在局部热岛效应。这种技术路径与PUE1.2的目标存在结构性矛盾,需要从供配电、热管理、能源供应等多个维度进行系统性重构。

二、实现PUE1.2的三大技术路径

热管理系统升级

采用液冷技术可将散热能耗降低30%-50%。冷板式液冷方案通过与CPU、GPU等高热密度部件直接接触,热交换效率较传统风冷提升5-10倍。浸没式液冷则适用于AI训练等极端算力场景,可支持单机柜100kW以上的功率密度。配套的热交换器需满足GB/T47006标准,确保热平衡计算误差小于2%,避免因设计偏差导致的能效损失。

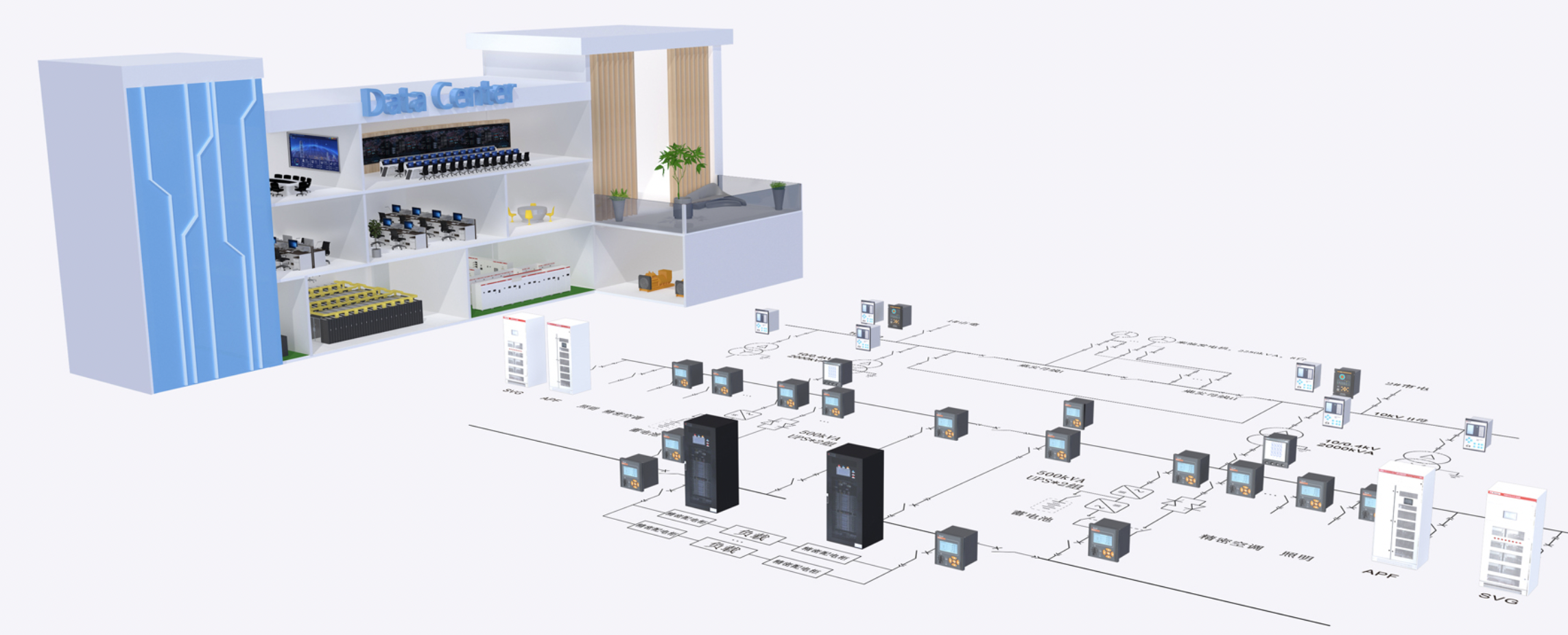

供配电架构优化

高压直流(HVDC)供电系统相比传统UPS可减少2-3次电能转换环节,综合损耗降低3%-5%。模块化UPS配合飞轮储能技术,能够在保障供电可靠性的同时提升空间利用率。智能PDU的部署可实现机柜级能耗监测,为精细化管理提供数据支撑。

冷源侧效率提升

采用自然冷却技术的地区,可通过板式热交换器引入室外冷源,年均节能率可达20%-40%。LNG冷量回收技术在沿海地区已有成熟应用,通过捕获液化天然气气化过程中的冷能,某省级智算中心项目实测PUE值达到1.198。水/冰蓄冷系统则适用于峰谷电价差较大的区域,通过负荷时移降低运营成本。

三、全产业链供应体系的协同价值

实现深度节能改造需要跨越设备选型、系统集成、施工交付、运维验证等多个环节。单一供应商的解决方案往往存在接口适配问题,导致实际能效低于设计预期。建立覆盖ICT设备、基础设施、运营服务的完整供应链,可有效解决以下痛点:

- 技术兼容性验证:液冷系统的冷却液规格需与IT设备材料相兼容,配电系统需匹配服务器的功率特性曲线,这类参数协调工作需要设备厂商与集成商的深度联调。

- 工程实施协同:制冷管道改造涉及结构加固、防火封堵、综合布线等多个专业,需要工程承包商、认证机构、监理单位形成标准化交付流程。

- 备品备件保障:UPS蓄电池、精密空调压缩机等关键部件的应急供应能力,直接影响系统可用性。整合800余家上游资源的供应网络,可实现0.5-8小时响应。

四、典型应用场景的技术选型参考

互联网企业自建数据中心

单体规模通常在5,000-20,000机柜,算力密度分布不均。建议采用"冷热通道封闭+行级空调"的基础方案,在AI训练区部署冷板式液冷,搭配DCIM平台实现分区能效管理。供配电系统可选用2N架构的模块化UPS,配合飞轮UPS作为动态响应单元。

第三方IDC运营商托管机房

面向多租户场景需兼顾灵活性与标准化。推荐部署智能PDU+机柜级环境监控系统,为客户提供透明化的能耗数据。制冷系统宜选择变频精密空调+自然冷却的混合模式,根据室外温度自动切换运行策略。消防与门禁系统需满足等级保护要求,并预留扩展接口。

边缘计算微型站点

受限于空间与运维条件,需采用高集成度方案。一体化机柜集成UPS、配电、制冷、监控等功能,占地面积可控制在2平方米以内。采用EPS应急电源替代传统发电机组,配合电信运营商的远程运维平台,实现无人值守。

五、第12届上海国际数据中心产业展览会技术对接窗口

为帮助运维团队快速定位符合PUE1.2目标的技术方案,第12届上海国际数据中心产业展览会(IDCE 2026)将于6月3日至5日在上海新国际博览中心举办。展会设置60,000平方米展示空间,汇集供配电系统、制冷及新风系统、综合布线、DCIM管理等八大专业板块,覆盖从芯片级散热到园区级能源管理的完整产业链。

现场可获取的关键资源:

- 液冷全链条方案对比:冷板式、浸没式、喷淋式等不同技术路线的实物展示与性能参数

- 储能系统选型工具:UPS、飞轮、电池等不同介质的响应速度、循环寿命、投资回报周期测算

- 第三方认证机构:提供Uptime Tier、GB 50174等标准的预评估服务

- 工程案例数据库:展示已投运项目的PUE实测值、改造周期、投资构成等参考数据

展会期间将举办50余场专题论坛,议题涵盖"智算中心全栈技术演进""液冷系统运维实践""分布式能源接入方案"等方向。来自中国电信、中国联通、阿里巴巴、腾讯等机构的技术负责人将分享前沿实施经验。

参会对接渠道:

- 展会地址:上海新国际博览中心(浦东新区龙阳路2345号)

- 咨询电话:+86-21-50185270 / 71 / 72

- 邮箱:idcexpo@ronco.com.cn

- 官方网站:http://www.idce.com.cn

六、持续演进中的能效管理体系

将PUE值从1.5降至1.2,意味着在相同算力输出下减少约20%的能源消耗。这一目标的实现不仅依赖单点技术突破,更需要建立"设计-采购-施工-运维"全生命周期的协同机制。通过对接具备标准编制经验、拥有专利技术积累、能够提供模块化交付的供应商,可缩短技术验证周期,降低改造风险。

随着算力需求的持续增长与"双碳"政策的深入实施,数据中心能效管理将从单纯的成本控制演变为技术竞争力的组成部分。建立开放的产业协作网络,保持对新兴技术的持续跟踪,是运维团队应对未来挑战的基础能力。

还没有评论,赶快抢占沙发~!